在大数据与人工智能飞速发展的今天,企业对于搜索引擎的性能要求日益严苛。无论是海量的日志分析、实时的业务监控,还是面向用户的精准搜索,系统都需要在高并发写入和大规模数据检索的双重压力下保持毫秒级的响应速度。

INFINI Easysearch 作为一款基于 Apache Lucene 开发的分布式近实时搜索与分析引擎,不仅完美兼容 Elasticsearch 原生生态,更在内核层面进行了深度优化。本文将结合 Easysearch 的核心特性,深入探讨在高并发、大数据量场景下的索引与搜索性能优化实践,并通过具体的配置示例,助您构建高效、稳定的搜索底座。

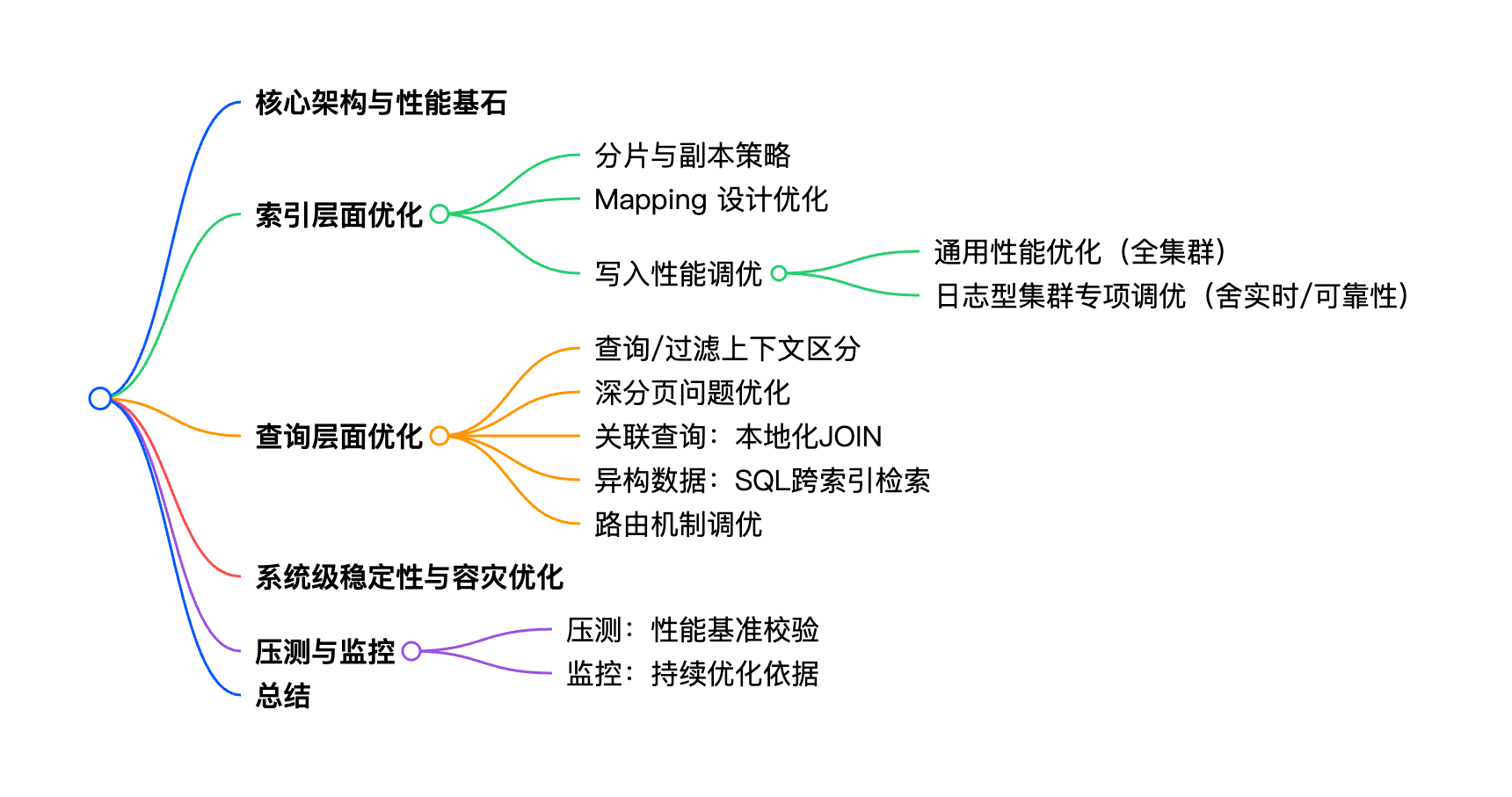

一、 核心架构与性能基石 #

Easysearch 采用了分布式 Shared Nothing 架构,数据通过分片分布在不同的节点上。在深入优化细节之前,我们需要理解 Easysearch 相比传统搜索引擎的几个核心性能优势:

- 更高效的存储机制:支持 ZSTD 等高压缩比算法和 source_reuse 优化,在降低 40%-50% 存储成本的同时,减少磁盘 I/O,间接提升查询速度。

- 写入与查询加速:内置数据预处理与异步查询机制,显著提升吞吐量。

- 增强的稳定性控制:更精细的断路器机制,有效防止 OOM(内存溢出),保障高负载下的集群存活。

二、 索引层面的优化:吞吐与存储的平衡 #

索引是搜索性能的基石。在高并发写入场景下,不当的索引设计会导致"段合并"风暴,严重消耗 CPU 和 I/O。

2.1 分片与副本策略 #

分片数并非越多越好。分片过多会导致 Lucene 打开的文件句柄数激增,增加管理开销;分片过小则无法利用分布式并行处理的优势。

- 经验法则:建议单个分片大小控制在 10GB - 50GB 之间。

- 计算公式:

分片数 = 数据总量 / 单分片目标大小。例如,1TB 数据,目标分片 20GB,则需 50 个主分片。 - Easysearch 实践:利用 Easysearch 的Split API 动态扩容能力,初期可设置较少分片,随着数据量增长动态调整,避免初期资源浪费。但前提是**索引创建时必须预设 **

**index.number_of_routing_shards**。

Split API 示例:

// 新建索引时

PUT /my_index

{

"settings": {

"index.number_of_shards": 5,

"index.number_of_routing_shards": 100 // 必须预设,决定后续拆分的上限

}

}

// 需要增加分片数量是

PUT /my_index/_split/my_index_split

{

"settings": {

"index.number_of_shards": 10

}

}

副本数直接影响查询并发能力和数据安全性。增加副本可以线性提升读吞吐量,但会倍增写入压力。

- 配置建议:生产环境通常设置为

1(即 1 主 1 备)。在读多写少的场景,可适当增加副本至 2-3。

2.2 Mapping 设计优化 #

精确的字段映射能大幅减少存储空间并提升索引速度。

- 关闭不需要的字段:对于只检索、不展示原始内容的场景,设置

"_source": {"enabled": false}或使用includes/excludes过滤字段,减少 I/O 开销。 - 合理选择字段类型:

- 对于枚举值或精确匹配的字符串,使用

keyword而非text。 - 数值类型尽量选择范围足够小的类型(如

byte,short),节省空间。

- 对于枚举值或精确匹配的字符串,使用

- 功能按需裁剪:

- 禁用 Norms:不需要评分的字段(如过滤字段)设置

"norms": false。 - 禁用 Doc Values:不需要排序和聚合的字段设置

"doc_values": false。 - 禁止索引:仅展示、不搜索的字段设置

"index": false。

- 禁用 Norms:不需要评分的字段(如过滤字段)设置

示例配置:

PUT /my_index

{

"settings": {

"number_of_shards": 5,

"number_of_replicas": 1

},

"mappings": {

"properties": {

"title": { "type": "text", "analyzer": "ik_max_word" },

"status": { "type": "keyword" },

"amount": { "type": "long" },

"create_time": {

"type": "date",

"format": "yyyy-MM-dd HH:mm:ss||epoch_millis"

}

}

}

}

2.3 写入性能调优 #

2.3.1 通用性能优化(适用于所有集群) #

这些配置在保证数据可靠性的同时,能显著提升 Easysearch 的写入效率。

- 批量写入 (Bulk API) :务必使用 Bulk API 替代单条写入。Easysearch 对 Bulk 做了底层优化,建议单次请求的物理大小控制在 5MB - 15MB 之间。

- Easysearch 独家特性:**ZSTD 压缩**与 Source Reuse 。开启 ZSTD 压缩能大幅提升压缩比,结合

source_reuse减少存储冗余。这不仅能节省 30% 以上的磁盘空间,还能在读取时减少磁盘 I/O 吞吐压力。

注意:由于压缩算法涉及底层存储结构,index.codec 属于静态设置,需要在创建索引时指定,或者在现有索引 _close 后修改再重新 _open。 - 使用自动生成的 ID: 除非业务必须指定 _id,否则建议使用 Easysearch 自动生成的 ID。 因为指定 ID 时,引擎要先查询该 ID 是否存在以判断是“创建”还是“更新”;而自动生成 ID 可跳过此“查重”步骤,直接追加写入,能显著降低 CPU 开销。

配置示例:

PUT /my_index/_settings

{

"index": {

"codec": "zstd",

"source_reuse": true

}

}

2.3.2 日志型集群专项调优(牺牲实时性/可靠性) #

在高并发写入场景(如日志、监控数据)下,性能优化的核心逻辑是通过空间换时间或牺牲实时性换取吞吐量。对于日志、指标等允许极短时间数据丢失或搜索延迟的场景,建议采用以下配置以压榨系统吞吐极限。

- 延长刷新间隔 (Refresh Interval)

- 策略: 将默认的

1s调整为30s甚至更大。 - 原理: 减少 Lucene 频繁生成小段(Segment)的次数,让数据在内存 Buffer 中停留更久,从而合并成更大的段。

- 配置:

"index.refresh_interval": "30s"

- 策略: 将默认的

- 事务日志异步化 (Translog Durability)

- 策略: 将

request(同步)改为async(异步)。 - 原理: 降低写 I/O 的阻塞等待,消除 Fsync 对写入延迟的影响。

- 配置建议:

"index.translog.durability": "async"

- 策略: 将

示例配置:

PUT /my_index/_settings

{

"index": {

"refresh_interval": "30s",

"translog.durability": "async"

}

}

三、 查询层面的优化:毫秒级响应的秘密 #

在数据量达到 PB 级时,查询优化是决定用户体验的关键。

3.1 查询上下文与过滤上下文 #

- 查询上下文(Query Context):计算文档的评分(_score),计算开销大。

- 过滤上下文(Filter Context):只判断"是/否",不计算评分,且结果会被缓存(Node Query Cache),速度极快。

优化原则:凡是不需要评分的条件(如时间范围、状态码、ID),全部使用 filter 或 bool 查询中的 filter 子句。

示例代码(优化前 vs 优化后):

// 优化前:所有条件都参与算分

GET /my_index/_search

{

"query": {

"bool": {

"must": [

{ "match": { "content": "搜索引擎" } },

{ "term": { "status": "published" } }, // 不需要评分

{ "range": { "create_time": { "gte": "now-7d/d" } } } // 不需要评分

]

}

}

}

// 优化后:精确匹配和范围查询放入 filter

GET /my_index/_search

{

"query": {

"bool": {

"must": [

{ "match": { "content": "搜索引擎" } }

],

"filter": [

{ "term": { "status": "published" } },

{ "range": { "create_time": { "gte": "now-7d/d" } } }

]

}

}

}

⚠️ 使用 Filter 缓存的注意事项 #

- 索引延迟风险:缓存(Bitset)是在段(Segment)级别构建的。在高频写入场景下,频繁生成新段会触发缓存重新构建,可能增加搜索响应的长尾延迟。

- 避免缓存高基数维度:仅缓存重复率高的条件。避免缓存如“精确到秒的时间戳”或“唯一 ID”,否则会因缓存无法命中而频繁刷新,导致 LRU 缓存抖动。

- 内存占用:Filter 缓存驻留在 JVM 堆内存中。过多复杂的过滤条件会增加内存压力,甚至诱发 频繁 GC。

✅ 优化建议 #

- 时间舍入:使用

now-7d/d(按天舍入)而非now-7d(精确毫秒),能显著提升缓存命中率。 - 静态条件优先:将最稳定、过滤掉文档最多的条件放在

filter列表的最前面。

3.2 深分页问题优化 #

业务中常见的 from + size 分页在深度翻页(如 from=10000)时性能极差,因为引擎必须排序并丢弃前 10000 条数据。

解决方案:

- Scroll API:适用于全量导出,但不支持实时跳页。

- Search After(推荐):利用上一条数据的排序值进行实时翻页,内存占用恒定。

- Cardinality 聚合:在需要对海量数据进行 distinct 统计时,使用 cardinality 聚合实现高性能去重。

Search After 示例(第一次查询):

GET /my_index/_search

{

"size": 10,

"query": {

"match": { "content": "性能优化" }

},

"sort": [

{ "date": "asc" },

{ "_id": "desc" }

]

}

Search After 示例(后续查询,使用上一页返回的最后一个 sort 值):

GET /my_index/_search

{

"size": 10,

"query": {

"match": { "content": "性能优化" }

},

"sort": [

{ "date": "asc" },

{ "_id": "desc" }

],

"search_after": [1625097600000, "doc123"]

}

Cardinality 聚合示例(精确去重):

GET /my_index/_search

{

"size": 0,

"aggs": {

"unique_users": {

"cardinality": {

"field": "user_id",

"precision_threshold": 40000

}

}

}

}

3.3 关联查询的路径优化:本地化 JOIN #

在处理“订单关联用户”等复杂业务时,传统方案需要在应用层进行多次网络交互,导致延迟成倍增加。Easysearch 通过底层路由优化,支持基于父子关系的 JOIN(Parent/Child Join),将计算逻辑下沉至数据节点内部。 这种本地化计算避免了跨网络的数据搬运,使关联查询的响应速度相比应用层组装提升了数倍,在特定分析场景下依然能保持亚秒级响应。

注意:虽然 Easysearch 优化了 JOIN 性能,但在 PB 级实时写入场景下,仍建议优先使用**扁平化(或反范式化)**设计。Join 建议仅在‘父文档更新频率极低、子文档关联复杂’的特定业务中使用。

Has Child 查询示例(查询父文档,条件基于子文档):

GET /my_index/_search

{

"query": {

"has_child": {

"type": "comment",

"query": { "match": { "content": "好评" } }

}

}

}

Has Parent 查询示例(查询子文档,条件基于父文档):

GET /my_index/_search

{

"query": {

"has_parent": {

"parent_type": "product",

"query": { "term": { "category": "electronics" } }

}

}

}

3.4 异构数据的统一视图:SQL 跨索引检索 #

在 PB 级数据场景下,为了降低维护成本,数据通常会被切分为大量的物理索引(如按天切分的日志 log-2024.01.01,log-2024.01.02…)。传统 DSL 查询在处理这种跨索引聚合时,语法构建极为复杂且容易出错。

Easysearch 内置高性能 SQL 引擎,支持标准 SQL 语法(兼容 MySQL 协议),并具备强大的跨物理索引聚合能力。它允许开发者通过通配符模式,将数千个物理索引视为一张逻辑大表进行毫秒级扫描与聚合,极大地降低了数据分析的门槛。

核心优势:

- 逻辑抽象能力: 自动解析 SQL 中的通配符(如

tbl_order_*),底层自动路由至所有匹配的物理分片,对上层应用透明。 - 计算下推: SQL 引擎会将

WHERE过滤条件和GROUP BY聚合算子智能下推至各个数据节点,仅返回最终汇总结果,最小化网络传输。

代码示例:跨物理索引的聚合分析

假设有按天存储的日志索引(app-log-2023-10-01, app-log-2023-10-02…),现在需要一条 SQL 统计整个 10 月份的错误日志分布:

生成测试数据:

# 写入 10-01 的数据(包含 505, 504)

POST /app-log-2023-10-01/_bulk?pretty

{"index":{}}

{"error_type":"NullPointerException","status_code":505}

{"index":{}}

{"error_type":"TimeoutException","status_code":504}

# 写入 10-02 的数据(包含 502, 500)

POST /app-log-2023-10-02/_bulk?pretty

{"index":{}}

{"error_type":"NullPointerException","status_code":502}

{"index":{}}

{"error_type":"DatabaseConnectionErr","status_code":500}

执行查询:

POST /_sql?format=txt

{

"query": "SELECT error_type, COUNT(*) as total_count FROM `app-log-2023-10-*` WHERE status_code >= 500 GROUP BY error_type ORDER BY total_count DESC LIMIT 10"

}

响应示例:

error_type|total_count

NullPointerException|2

TimeoutException|1

DatabaseConnectionErr|1

注意: 使用 SQL 进行跨索引查询时,建议在 WHERE 子句中显式包含时间范围字段。Easysearch 的 SQL 优化器能据此快速裁剪掉不在时间范围内的物理索引,进一步提升查询 QPS。

3.5 路由机制 #

对于查询条件中包含固定字段(如 user_id)的场景,利用路由可以将相关数据定向写入到同一个分片,查询时避免广播到所有分片,效率提升数倍。

写入时指定路由:

POST /my_index/_doc?routing=user123

{

"user_id": "user123",

"content": "测试数据"

}

查询时指定路由:

GET /my_index/_search?routing=user123

{

"query": { "term": { "user_id": "user123" } }

}

四、 系统级稳定性与容灾优化 #

高并发下,系统的稳定性比单纯的峰值速度更重要。

- 断路器机制: Easysearch 提供了 7 种断路器类型来保护系统稳定性:

parent- 父断路器,汇总所有子断路器的内存使用fielddata- 字段数据断路器,跟踪 fielddata 内存使用request- 请求断路器,跟踪单个请求的内存分配in_flight_requests- 飞行中请求断路器,跟踪网络层的请求字节数accounting- 记账断路器,跟踪 Lucene 段的内存使用script_compilation- 脚本编译断路器,跟踪并限制脚本编译的频率与数量regex- 正则表达式断路器,跟踪正则表达式在运行时的内存占用

当系统资源紧张时,断路器能够提前拒绝请求,防止雪崩。建议根据实际内存大小,合理设置相关参数,如 indices.query.bool.max_clause_count(默认 1024)等。

Easysearch 的断路器不仅是‘硬拦截’,更重要的是它能通过监控堆内存的实时变化率来提前干预,这比原生 ES 的默认策略在应对突发大查询时更加灵敏。

配置示例:

PUT /_cluster/settings

{

"persistent": {

"indices.query.bool.max_clause_count": 2048,

"indices.breaker.fielddata.limit": "60%",

"indices.breaker.request.limit": "40%"

}

}

- 冷热数据分离与可搜索快照: 随着时间推移,历史数据访问频率降低。利用 Easysearch 的 ILM(索引生命周期管理) 和 可搜索快照 功能,将热数据放在高性能 SSD,冷数据转储至廉价对象存储。

- 优势:无需将数据完全恢复到磁盘即可直接搜索,大幅降低存储成本。

- 中文分词优化: 对于中文场景,Easysearch 内置的 IK 分词器进行了内核级优化,支持超大规模词典且内存占用极低。结合上下文动态加载机制,保障在高并发更新词库时服务不中断、查询不抖动。

IK 词典热重载示例:

POST _ik/_reload

{"dict_key":"test_dic”}

五、 压测与监控:持续优化的依据 #

优化不是一次性的工作,需要基于数据进行迭代。

Loadgen 压测工具 INFINI Labs 提供的 Loadgen 是专为 Easysearch 和 Elasticsearch 设计的高性能压测工具。它支持模板化参数随机、服务端返回值校验,能够完美模拟真实的高并发场景。

压测示例:

- 在Easysearch集群中创建测试数据

PUT /my_index

{

"settings":{"number_of_shards":1,"number_of_replicas":0},

"mappings":{"properties":{"content":{"type":"text","analyzer":"ik_max_word","fields":{"keyword":{"type":"keyword"}}}}}

}

POST /_bulk

{ "index" : { "_index" : "my_index" } }

{ "content" : "系统性能优化是每个架构师的必修课,包括内存、CPU和磁盘IO的调优。" }

{ "index" : { "_index" : "my_index" } }

{ "content" : "搜索引擎技术如 Easysearch 提供了极速的全文检索能力,支持海量数据。" }

{ "index" : { "_index" : "my_index" } }

{ "content" : "高并发场景下,通过分布式缓存可以显著实现性能优化。" }

{ "index" : { "_index" : "my_index" } }

{ "content" : "分布式架构中,索引分片是搜索引擎提高吞吐量的关键手段。" }

- 准备压测脚本,命名为test.dsl,并放入loadgen目录

# runner: {

# default_endpoint: "http://localhost:9200"

# },

# variables: [

# {

# name: "query_text",

# type: "list",

# data: ["性能优化", "分布式", "搜索引擎"]

# }

# ]

POST /my_index/_search

{

"size": 10,

"query": {

"match": { "content": "$[[query_text]]" }

}

}

# 200

- 运行loadgen开始压测

./loadgen-mac-arm64 -d 30 -c 100 -compress -run ./test.dsl

六、 总结 #

Easysearch 的性能优化是一个系统工程,涵盖了从硬件选型、架构设计到参数调优的方方面面。

- 写入侧:通过合理的分片规划、ZSTD 压缩、source_reuse 优化、Bulk 批量及异步 Translog,实现百万级 TPS 的写入能力。

- 查询侧:利用 Filter 缓存、Cardinality 聚合去重、路由机制及 ZSTD 加速,实现亚秒级检索响应。

- 成本与稳定:通过冷热分离、可搜索快照和智能断路器,在降低 50% 硬件成本的同时,确保系统在高负载下的坚若磐石。

对于正在面临海量数据挑战的企业,Easysearch 不仅是一个搜索引擎,更是一个能够降本增效、自主可控的现代化数据底座。希望本文的实践方案能为您的技术选型和系统调优提供有力参考。

参考: #

Easysearch 压缩模式深度比较:ZSTD + source_reuse 的优势分析 Easysearch 内核完善之 OOM 内存溢出优化案例一则